OpenVPN туннель PFsense+Mikrotik

-

Аналогично.

Несколько филиалов работают с клиентами на Микротик.

Не осилите - приведу скриншоты.

По поводу скоростей. Несмотря на TCP-only со стороны Микротика скорости практически равны максимальным по тарифам провайдеров, т.е. 2-2,5 Мегабайт\сек.P.S. Для tun про iroute (IPv4 Remote Network/s ) в Client Specific Overrides не забыли?

-

Доброе

@Sonya:Но скорость через туннель крайне низкая, где-то 300кбайт в сек.

https://habrahabr.ru/post/246953/

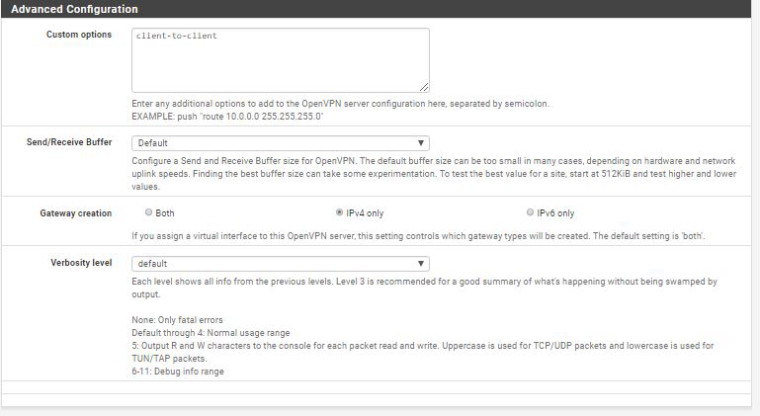

На стороне сервера в Доп. настройках попробуйте :

sndbuf 100000; rcvbuf 100000; push "sndbuf 100000"; push "rcvbuf 100000";И перезапустить туннель.

-

P.S. Для tun про iroute (IPv4 Remote Network/s ) в Client Specific Overrides не забыли?

Делал по этому руководству, там про iroute нет упоминания. Как это реализовать в pfsense?

-

На стороне сервера в Доп. настройках попробуйте :

sndbuf 100000; rcvbuf 100000; push "sndbuf 100000"; push "rcvbuf 100000";И перезапустить туннель.

Добавил. Вроде стало чуток получше, пиковая скорость поднялась до 800килов, а средняя осталась прежней. Скорее всего, это потолок для моего подключения.

-

P.S. Для tun про iroute (IPv4 Remote Network/s ) в Client Specific Overrides не забыли?

Делал по этому руководству, там про iroute нет упоминания. Как это реализовать в pfsense?

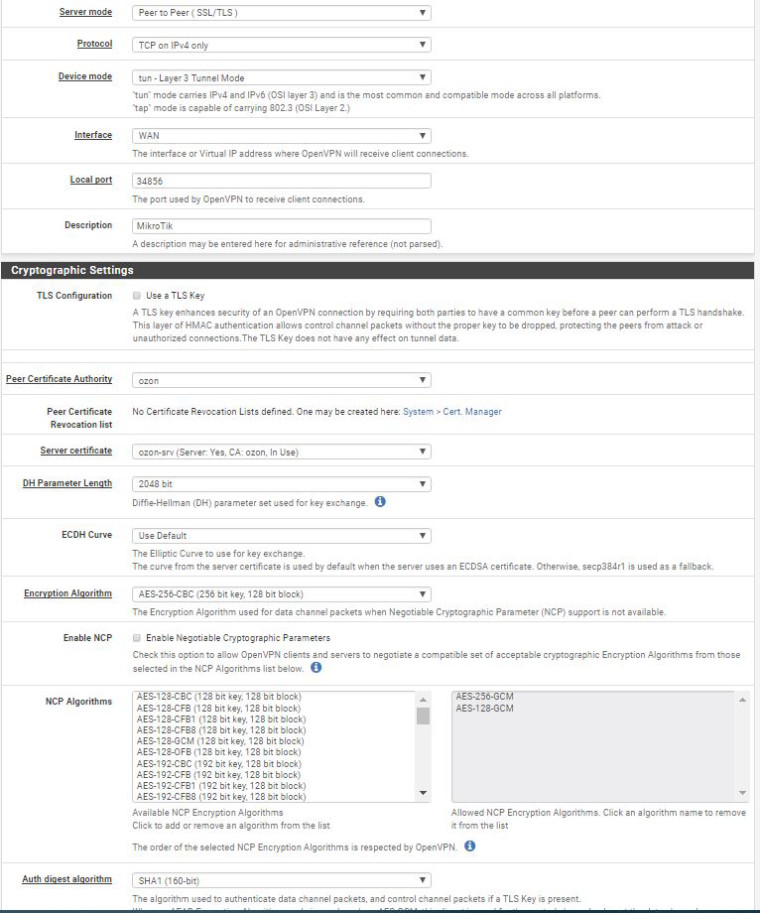

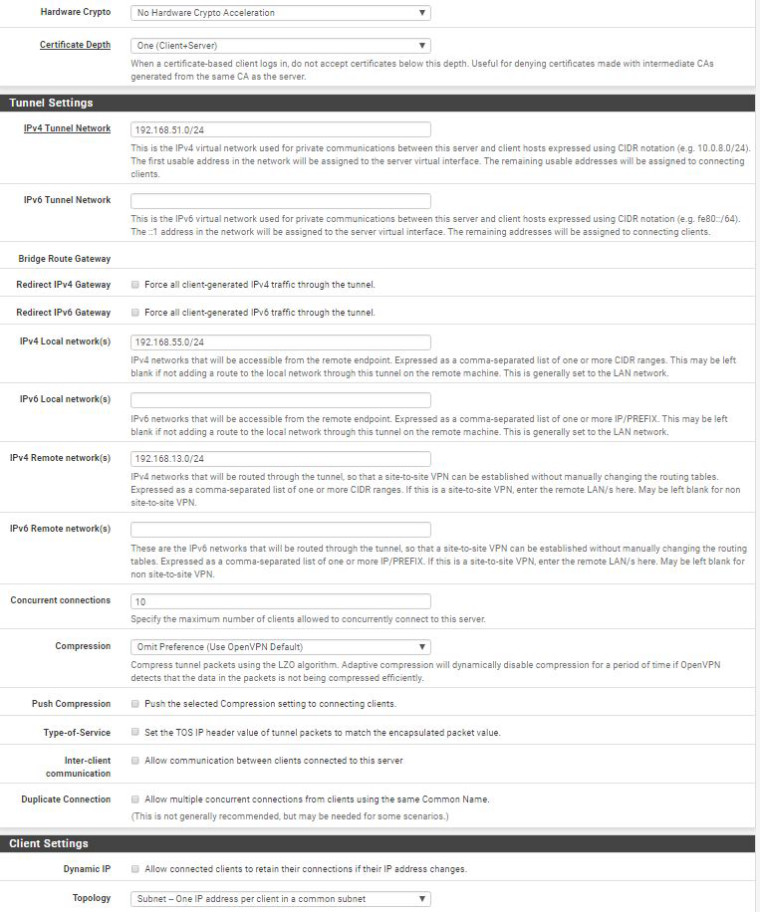

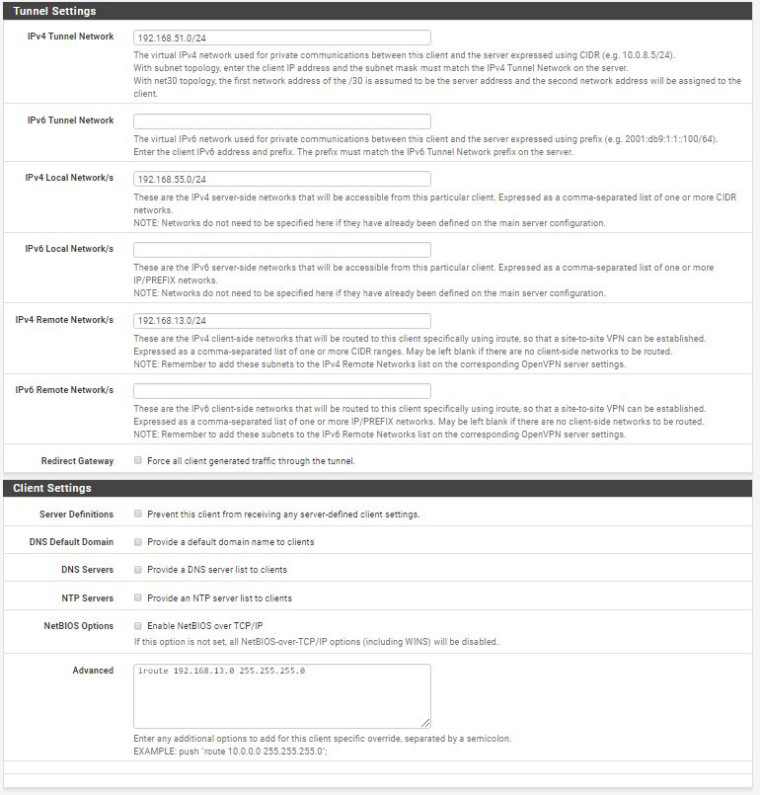

iroute оно же - IPv4 Remote Network/s указывается в записи в Client Specific Overrides , вручную создаваемой вами для Common Name сертификата вашего Микротик-клиента.

-

IPv4 Remote Network/s указывается в записи в Client Specific Overrides , вручную создаваемой вами для Common Name сертификата вашего Микротик-клиента.

Благодарю за подсказку.

Прописал в Client Specific Overrides те же параметры, что и в основном соединении, через tun теперь тоже заработало.

Вопрос можно считать закрытым. -

Вопрос можно считать закрытым

А что со скоростью?

-

А что со скоростью?

Сейчас соединил оба роутера напрямую. Скорость по туннелю 2800 кбайт (внутри локалки 11400 кбайт между теми же машинами). Что с настройками буфера, что без них.

Такое ощущение, что у туннеля большие накладные расходы. -

Да, OpenVPN не отличается особой производительностью на не очень мощных устройствах.

Проверьте загрузку CPU в Микротике под полной нагрузкой, наверняка она будет близка к 100%. -

Доброе.

@pigbrother:Да, OpenVPN не отличается особой производительностью на не очень мощных устройствах.

Проверьте загрузку CPU в Микротике под полной нагрузкой, наверняка она будет близка к 100%.Дело в том, что МТ умеет OpenVPN только по TCP . Соотвественно все накладные расходы по контролю передачи данных ложатся на CPU уст-ва.

P.s. И еще. МТ не умеет hw nat. Совсем. И снова все накл. расходы на CPU. Не зря у них CCR по неск. десятков ядер имеют. Без hw nat passthrough по др. никак.

-

Соотвественно все накладные расходы по контролю передачи данных ложатся на CPU уст-ва.

UDP не сильно разгружает CPU. Тестировал на pfSense, при сходных скоростях разница в загрузке CPU при TCP\UDP не была драматической.

Дело в "слабости" CPU МТ. IPsec, реализация которого в МТ весьма достойна, тоже ощутимо грузит CPU.

А так - я вами согласен и ваше писал:

Проверьте загрузку CPU в Микротике под полной нагрузкой, наверняка она будет близка к 100%.И еще. МТ не умеет hw nat.

В последних версиях появились FastTrack и Fast Path. Это, конечно, не hw nat, но эффект от нововведений ощутим. -

@pigbrother

доброго времени суток,

борюсь с pfsense 2.4.3...

связка openvpn pfsense(srv)-mikrotik(client)

все сделал как было сказано выше...

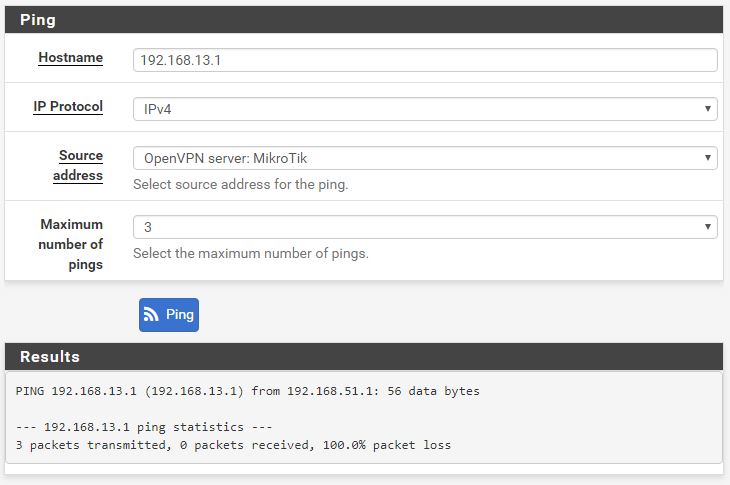

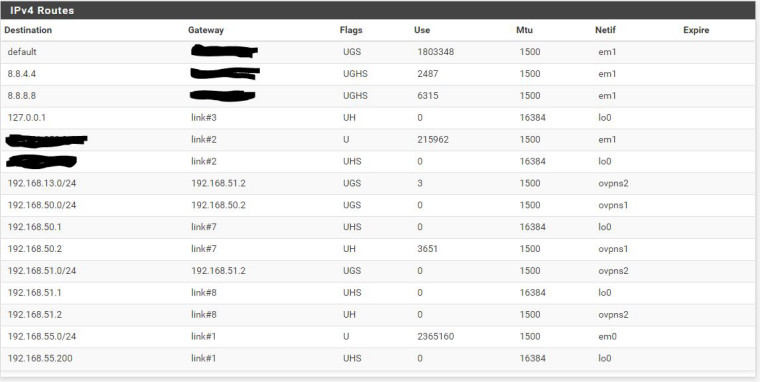

но сеть видна только в одну сторону. со стороны mikrotik'а я вижу сеть за pfsense, а вот наоборот никак...

Client Specific Overrides прописан, в таблице маршрутизации запись есть... но пинг на устройства за mikrotik'ом не ходят...

-

Запись iroute - это часом не настройки сервера? Или все же в Client Specific Overrides. Не вижу упоминаний о common name клиента.

-

@pigbrother

iroute в Client Specific Overrides.ЗЫ: Спасибо добрый человек... была очепятка в common name клиента.

ее поправил и все полетело :)